基於Token倉架構的AI推理記憶體瓶解決方案

近年來,人工智能(AI)技術的發展日成熟,各個領域都在積極應用AI技術。然而,AI推理(Inference)過程中存在著記憶體瓶問題,重影響著AI系統的效能。為了解決這個問題,基於Token倉架構的AI推理記憶體瓶解決方案應運而生。

Token倉架構

Token倉架構是一種新型的倉結構,在提高AI推理過程中的記憶體效能。這種架構通過將AI模型的參數和中間結果存在Token倉中,從而減少了記憶體的訪問延和能耗。

根據Cerebras的技術路線,採用的晶級引(WSE)架構可以將整個AI模型置於單個超大型晶晶片上,避免GPU集群間數據傳輸的通訊開銷。這種架構可以大大提高AI推理的效能和能效。

AI推理記憶體瓶解決方案

基於Token倉架構的AI推理記憶體瓶解決方案主要包括以下幾個方面:

1. **大型模型支持**:基於Token倉架構的AI推理系統可以支持大型模型的訓練和推理,從而提高AI系統的準確性和效能。

2. **記憶體優化**:通過優化記憶體存和訪問,基於Token倉架構的AI推理系統可以大大減少記憶體瓶,提高AI推理的效能。

3. **能耗降低**:基於Token倉架構的AI推理系統可以降低能耗,從而提高AI系統的可持續性和環境友好性。

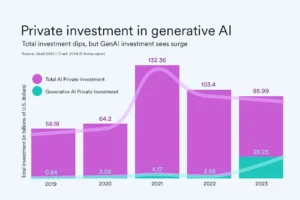

市場勢與投資建議

根據市場勢,AI推理市場正在迅速發展,基於Token倉架構的AI推理記憶體瓶解決方案具有廣的市場前景。投資者可以考投資基於Token倉架構的AI推理公司,例如Cerebras等。

結論

基於Token倉架構的AI推理記憶體瓶解決方案是一種新型的技術解決方案,在提高AI推理過程中的記憶體效能。這種解決方案具有廣的市場前景,投資者可以考投資基於Token倉架構的AI推理公司。

參考資料與原文來源

- 原文來源: ChatGPT 深度研究:2025 年AI 大模型产业链全景与未来机遇

- 原文來源: AI推理狂潮來臨,輝達挑戰者Cerebras募資10億美元

- 原文來源: 双轮驱动人工智能产业加速发展

🧠本文由 DreamJ AI 技術新聞生成系統 自動撰寫並進行語意優化,僅供技術研究與教學使用。

請以原廠公告、CVE 官方資料與安全建議為最終依據。

發佈留言